目录

我们知道HTTP传输的都是明文数据,黑客很容易截获到传输的数据,安全性很差,相当于在互联网上裸奔。对于敏感数据需要用HTTPS传输,那么HTTPS怎么保证数据安全的呢?这要从对称加密和非对称加密讲起。

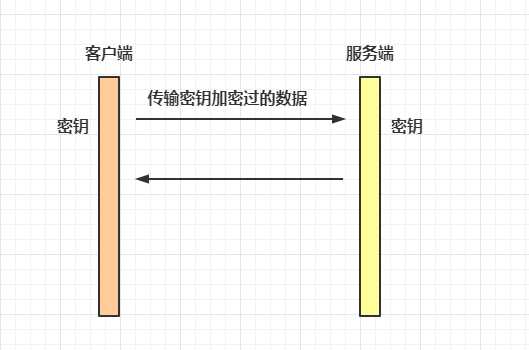

所谓的对称加密,就是对数据的加密和解密都是用的同一个密钥

这里传输的数据不是明文了,而是用密码加密后的密文,黑客截获到了密文也不知道原始数据是什么,但是有以下问题:

针对以上问题,需要引入非对称加密

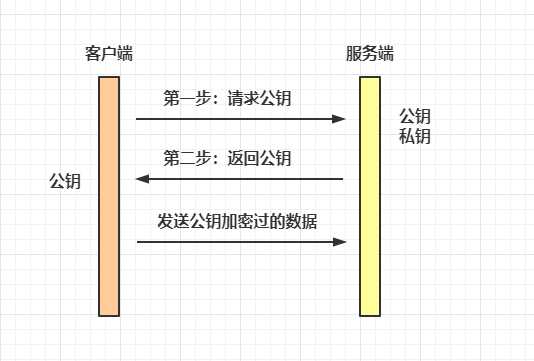

与对称加密客户端和服务端只有一个密钥不同的是,非对称加密存在公钥和私钥两种密钥,特点是公钥加密过的数据私钥可以解密,私钥加密过的数据公钥可以解密。

客户端与服务端数据交互过程如下:

我们来看一下这个过程有什么问题,首先客户端向服务端发送数据的过程肯定是安全的,因为只有服务端有私钥可以解密数据,但是服务端怎么向客户端安全地发送数据呢?

所以需要对称加密和非对称加密结合起来解决这个问题